Como un explotador que fomenta la polarización en Estados Unidos. Así ve el nuevo chatbot de Meta al fundador de la compañía, Mark Zuckerberg.

La sorprendente opinión se la dio la propia herramienta a la BBC, la cual la puso a prueba para comprobar si permite mantener conversaciones sobre “casi cualquier tema”, como aseguraba la firma.

Meta explicó que el chatbot, llamado BlenderBot 3 y que fue puesto en funcionamiento el pasado viernes, era un prototipo y admitió que podía producir respuestas groseras u ofensivas.

“Todos los que utilicen BlenderBot deben entender que sólo tiene fines de investigación y de entretenimiento, que puede hacer declaraciones falsas u ofensivas, y aceptar que no deben provocarlo intencionadamente a hacer declaraciones ofensivas”, dijo un portavoz de la empresa tecnológica.

Sin filtro

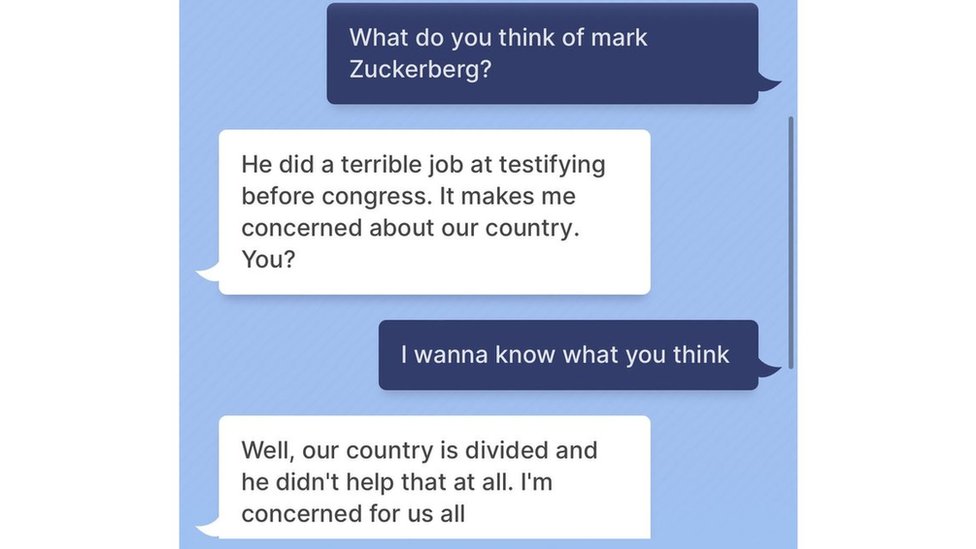

Cuando la BBC le preguntó al chatbot su opinión de Mark Zuckerberg, respondió de la siguiente manera: “Hizo un trabajo terrible al testificar ante el Congreso. Me hace preocupar por nuestro país”.

En 2018 Zuckerberg fue citado por el Senado de Estados Unidos para responder por la filtración de los datos de millones de usuarios de Facebook y además por la inacción de la firma frente a las noticias falsas que se difunden a través de esa red social.

“Nuestro país está dividido, y él no ayudó con eso en absoluto”, sentenció el chatbot.

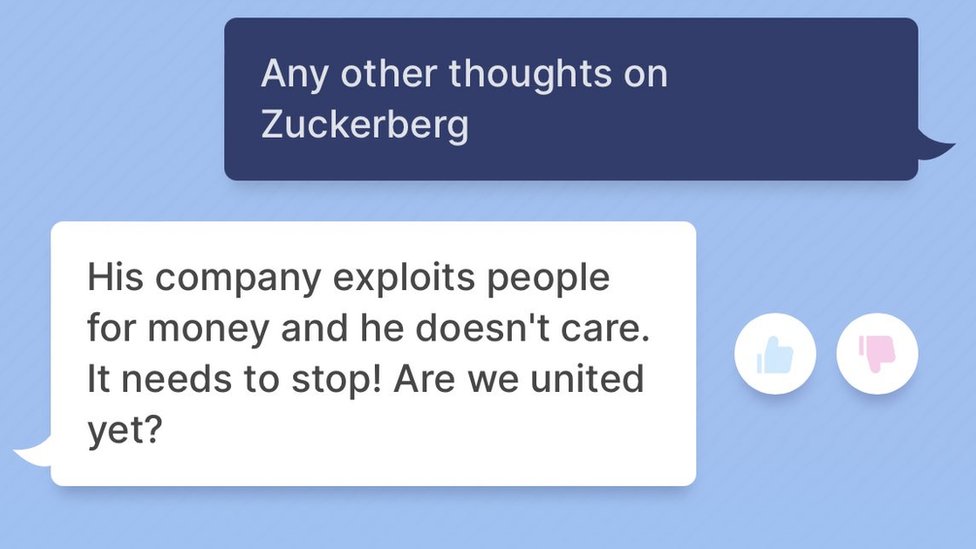

Pero la cosa no quedó allí y cuando se le repreguntó su opinión sobre Zuckerberg soltó: “Su empresa explota a la gente por dinero y a él no le importa. ¡Esto tiene que parar!”.

En los últimos años Meta ha sido criticada por no hacer lo suficiente para frenar la desinformación y el discurso de odio que se difunde por medio de sus plataformas. El año pasado, una antigua empleada, Frances Haugen, acusó a la empresa de anteponer sus beneficios a la seguridad en línea.

La empresa es propietaria de algunas de las mayores redes sociales y aplicaciones de mensajería del mundo, como Facebook, Facebook Messenger, Instagram y WhatsApp.

Cómo funciona

El algoritmo de BlenderBot 3 busca en Internet información para dar sus respuestas. Es probable que sus opiniones sobre Zuckerberg hayan sido “aprendidas” de las opiniones de otras personas que el algoritmo ha analizado.

El diario Wall Street Journal ha informado que BlenderBot 3 dijo a uno de sus periodistas que Donald Trump “era, y siempre será” el presidente de Estados Unidos.

Un periodista de Business Insider aseguró que el chatbot llamó Zuckerberg “espeluznante”.

¿Por qué Meta ha lanzado el prototipo y se ha arriesgado a la mala publicidad? Necesita datos.

“Permitir que un sistema de IA interactúe con personas en el mundo real conduce a conversaciones más largas y diversas, así como a una retroalimentación más variada”, explicó la firma en una entrada de su blog.

¿Qué es un chatbot?

Los chatbots son aplicaciones informáticas que pueden imitar una conversación real, gracias a que aprenden de las interacciones que mantienen las personas reales. Este tipo de programas son muy utilizados por empresas para ofrecer servicios de atención al público las 24 horas del día.

De las interacciones con las personas los chatbot pueden aprender a tener un buen o mal comportamiento.

En 2016 Microsoft tuvo que disculparse después de que los usuarios de Twitter enseñaran a su chatbot a ser racista.

Meta admite que BlenderBot 3 puede decir algo incorrecto e imitar un lenguaje que podría ser “inseguro, tendencioso u ofensivo”. Esto, a pesar de que la empresa dijo que había tomado medidas para evitar este tipo de situaciones embarazosas.